การบังคับใช้และการใช้งานของโมเดล Machine Learning ได้รับการทดสอบจากข้อมูล ความน่าเชื่อถือของการทดสอบขึ้นอยู่กับปริมาณและคุณภาพของข้อมูลที่ใช้แบบจำลองเหล่านี้เป็นอย่างมาก เป็นงานที่สมบูรณ์ในตัวมันเองในการสร้าง รับ และล้างชุดข้อมูลขนาดใหญ่ที่เหมาะสมเพื่อทดสอบ “ การประมวลผลภาษาธรรมชาติ (เอ็นแอลพี) ” โมเดลการเรียนรู้ของเครื่อง

Hugging Face นำเสนอโซลูชั่นที่เรียบร้อยสำหรับสิ่งนี้ด้วยคลังชุดข้อมูลขนาดใหญ่เป็นพิเศษที่ให้เลือกและค้นหาชุดที่ตรงกับความต้องการของคุณอย่างสมบูรณ์แบบ ที่นี่ เราจะแสดงวิธีค้นหาชุดข้อมูลในอุดมคติและจัดเตรียมเพื่อทดสอบแบบจำลองของคุณอย่างเพียงพอ

วิธีใช้ชุดข้อมูล Hugging Face

เราจะแสดงวิธีใช้ชุดข้อมูล Hugging Face โดยใช้ตัวอย่าง ' TinyStories ” ชุดข้อมูลจาก Hugging Face

ตัวอย่าง

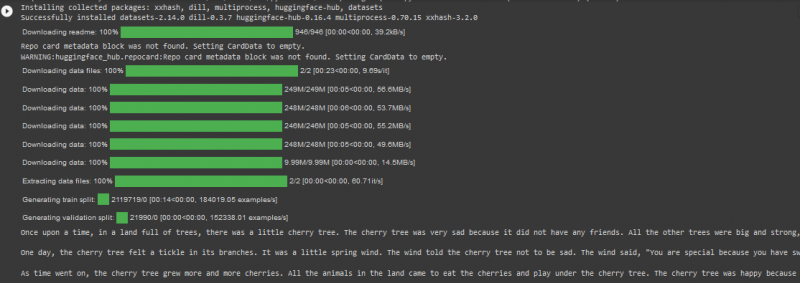

ชุดข้อมูล TinyStories มีข้อมูลมากกว่า 2 ล้านแถวในการแยกรถไฟ และมีการดาวน์โหลดมากกว่า 2 พันครั้งบนแพลตฟอร์ม Hugging Face เราจะใช้ในโค้ดใน Google Colab ที่ระบุด้านล่าง:

! ปิ๊ป ติดตั้ง หม้อแปลงไฟฟ้า

! ปิ๊ป ติดตั้ง ชุดข้อมูล

จากชุดข้อมูลนำเข้า load_dataset

ชุดข้อมูล = load_dataset ( 'โรเนลดัน/ไทนี่สตอรี่' )

TinyStories_Story = 3

example_string = ชุดข้อมูล [ 'รถไฟ' ] [ TinyStories_เรื่องราว ] [ 'ข้อความ' ]

พิมพ์ ( example_string )

ในรหัสนี้ ให้พิจารณาขั้นตอนที่ระบุไว้ด้านล่าง:

ขั้นตอนที่ 01 : ขั้นตอนแรกคือ “ การติดตั้ง ” ของชุดข้อมูลหม้อแปลง

ขั้นตอนที่ 02 : ถัดไป นำเข้าชุดข้อมูลที่ต้องการ “ TinyStories ” ในโครงการของคุณ

ขั้นตอนที่ 03 : จากนั้นให้โหลดชุดข้อมูลที่เลือกโดยใช้ปุ่ม “ load_dataset() ' การทำงาน.

ขั้นตอนที่ 04 : ตอนนี้เราระบุหมายเลข Story ที่เราต้องการจากชุดข้อมูล TinyStories เราได้ระบุหมายเลข 03 ในตัวอย่างโค้ดของเรา

ขั้นตอนที่ 05 : สุดท้ายนี้ เราจะใช้เมธอด “print()” เพื่อแสดงผลลัพธ์

เอาท์พุต

บันทึก: โค้ดและผลลัพธ์สามารถดูได้โดยตรงใน Google Colab ของเรา .

บทสรุป

“ ชุดข้อมูล Hugging Face ” ทำให้ผู้ใช้สามารถทดสอบโมเดล Machine Learning ของตนได้อย่างมีประสิทธิภาพอย่างเหลือเชื่อ ในขณะที่นำเข้าชุดข้อมูลขนาดใหญ่จากไลบรารีออนไลน์โดยตรง เป็นผลให้การประยุกต์ใช้อัลกอริธึม NLP กลายเป็นเรื่องง่ายและรวดเร็วยิ่งขึ้น เนื่องจากโปรแกรมเมอร์สามารถทดสอบโปรเจ็กต์ของตนกับชุดข้อมูลที่มีทั้งคุณภาพและปริมาณได้