ในบล็อกนี้ เราจะกล่าวถึงเนื้อหาด้านล่างนี้:

- จะปรับแต่งการสร้างข้อความโดยการโหลดโมเดลด้วยฟังก์ชัน 'ไปป์ไลน์' จาก Transformers ได้อย่างไร

- จะใช้โมเดลที่ใช้ Transformer เพื่อสร้างข้อความใน PyTorch ได้อย่างไร

- จะใช้โมเดลที่ใช้ Transformer เพื่อสร้างข้อความใน TensorFlow ได้อย่างไร

จะปรับแต่งการสร้างข้อความโดยการโหลดโมเดลด้วยฟังก์ชัน 'ไปป์ไลน์' จาก Transformers ได้อย่างไร

“ ไปป์ไลน์ ” ใช้เพื่อดาวน์โหลดโมเดล AI ที่ได้รับการฝึกล่วงหน้าโดยอัตโนมัติตามความต้องการของผู้ใช้ หากต้องการใช้ฟังก์ชันเฉพาะนี้ ผู้ใช้จำเป็นต้องติดตั้ง ' หม้อแปลงไฟฟ้า ” แพ็คเกจ แพ็คเกจนี้ให้สิทธิ์ในการเข้าถึงโมเดลที่ใช้ Transformer ที่ทันสมัยซึ่งสามารถวิเคราะห์ความรู้สึกได้ รวมถึงโมเดลอื่นๆ อีกมากมาย การประมวลผลภาษาธรรมชาติ (NLP) งาน

หากต้องการดูการสาธิตการใช้งานจริงของสถานการณ์ที่อธิบายไว้ข้างต้น ให้ไปที่ขั้นตอนด้านล่าง!

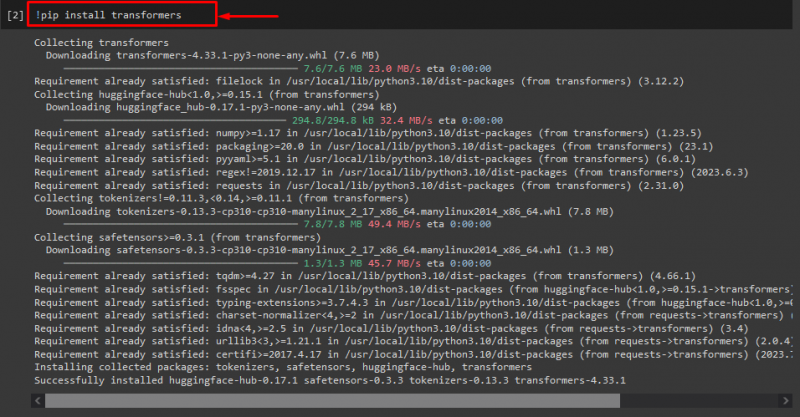

ขั้นตอนที่ 1: ติดตั้งแพ็คเกจ 'หม้อแปลง'

เริ่มแรกให้รันคำสั่ง “! ปิ๊บ” คำสั่งในการติดตั้งแพ็คเกจหม้อแปลง:

! pip ติดตั้งหม้อแปลง

อย่างที่คุณเห็น แพ็คเกจที่ระบุได้รับการติดตั้งสำเร็จแล้ว:

ขั้นตอนที่ 2: นำเข้าโมเดลที่ใช้หม้อแปลงไฟฟ้า

หลังจากนั้น นำเข้าโมเดลที่ใช้หม้อแปลงไฟฟ้าที่จำเป็น โดยขั้นแรกให้นำเข้าไฟล์ “ ไปป์ไลน์ ” ฟังก์ชันจาก “ หม้อแปลงไฟฟ้า '. จากนั้นใช้ฟังก์ชันที่นำเข้าและส่งผ่าน ' การสร้างข้อความ ” เป็นข้อโต้แย้งพร้อมกับชื่อรุ่นที่ต้องการ “ GPT2 '. จากนั้นส่งต่อไปที่ “ สร้าง ' ตัวแปร:

จาก หม้อแปลงไฟฟ้า นำเข้า ไปป์ไลน์

สร้าง = ไปป์ไลน์ ( 'การสร้างข้อความ' , แบบอย่าง = 'gpt2' )

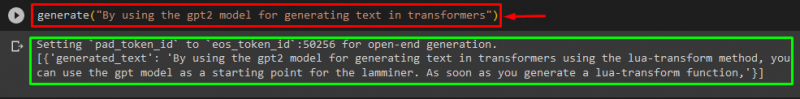

ขั้นตอนที่ 3: สร้างปรับแต่งข้อความ

ตอนนี้ส่งข้อความที่ต้องการเป็นอาร์กิวเมนต์ไปที่ “ สร้าง '. ดังที่แสดงด้านล่าง:

สร้าง ( “โดยใช้โมเดล gpt2 เพื่อสร้างข้อความในหม้อแปลง” )ตามผลลัพธ์ที่ให้ไว้ การดาวน์โหลดที่ผ่านการฝึกอบรมล่วงหน้าแล้ว “ GPT3 ” ข้อความสร้างโมเดลสำเร็จแล้ว:

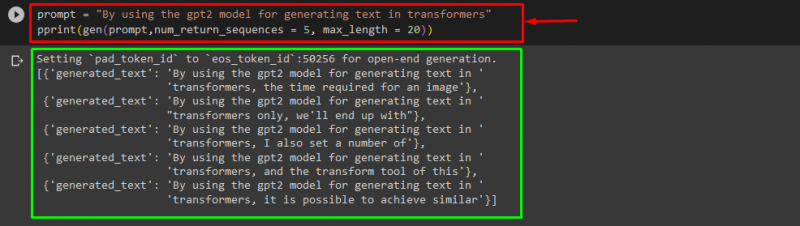

คุณยังสามารถใช้อาร์กิวเมนต์อื่นๆ ได้ เช่น:

พร้อมท์ = “โดยใช้โมเดล gpt2 เพื่อสร้างข้อความในหม้อแปลง”พิมพ์ ( ยีน ( พร้อมท์ , num_return_sequences = 5 , สูงสุด_ความยาว = ยี่สิบ ) )

ที่นี่:

- “ พร้อมท์ ” ถูกใช้เป็นอาร์กิวเมนต์ที่เก็บข้อมูลอินพุต

- “ num_return_sequence ” อาร์กิวเมนต์ใช้เพื่อสร้างจำนวนลำดับของข้อความที่ให้ไว้

- “ สูงสุด_ความยาว ” อาร์กิวเมนต์ใช้เพื่อระบุความยาวของข้อความที่สร้างขึ้น ในกรณีของเราจำกัดอยู่เพียง “ 30 ” โทเค็น (คำหรือเครื่องหมายวรรคตอน):

บันทึก: ข้อความที่กำหนดเองจะเป็นความต่อเนื่องของพรอมต์ที่ระบุซึ่งอิงตามข้อมูลการฝึกของโมเดล

จะใช้โมเดลที่ใช้ Transformer เพื่อสร้างข้อความใน PyTorch ได้อย่างไร

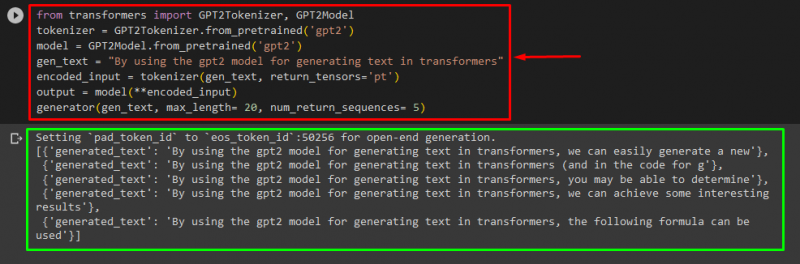

ผู้ใช้ยังสามารถปรับแต่งข้อความใน “ ไพทอร์ช ” ซึ่งเป็น “ คบเพลิง ” กรอบการเรียนรู้ของเครื่องตาม มันถูกใช้สำหรับการใช้งานที่แตกต่างกัน เช่น NLP และ Computer Vision หากต้องการใช้โมเดลที่ใช้หม้อแปลงเพื่อปรับแต่งข้อความใน PyTorch ขั้นแรก ให้นำเข้าไฟล์ “ GPT2Tokenizer ' และ ' GPT2โมเดล ” ฟังก์ชั่นจาก “ หม้อแปลงไฟฟ้า ”:

จาก หม้อแปลงไฟฟ้า นำเข้า GPT2Tokenizer , GPT2โมเดลจากนั้นใช้เครื่องหมาย “ GPT2Tokenizer ” tokenizer ตามโมเดลก่อนการฝึกที่เราต้องการชื่อ “ GPT2 ”:

โทเค็นไนเซอร์ = GPT2Tokenizer. from_pretrained ( 'gpt2' )หลังจากนั้น ให้ยกตัวอย่างน้ำหนักจากแบบจำลองที่ผ่านการฝึกอบรมมาแล้ว:

แบบอย่าง = GPT2โมเดล from_pretrained ( 'gpt2' )ต่อไปประกาศ “ gen_text ” ตัวแปรที่เก็บข้อความที่เราต้องการปรับแต่ง:

gen_text = “โดยใช้โมเดล gpt2 เพื่อสร้างข้อความในหม้อแปลง”ตอนนี้ส่งผ่าน ' gen_text ' และ ' return_tensors='pt' ” เป็นอาร์กิวเมนต์ที่จะสร้างข้อความใน PyTorch และเก็บค่าที่สร้างขึ้นไว้ใน “ encoded_input ' ตัวแปร:

encoded_input = โทเค็นไนเซอร์ ( gen_text , return_tensors = 'พอยต์' )สุดท้ายนี้ให้ผ่าน “ encoded_input ” ตัวแปรที่เก็บข้อความที่ปรับแต่งไว้ที่ “ แบบอย่าง ” เป็นพารามิเตอร์และรับผลลัพธ์ผลลัพธ์โดยใช้คำสั่ง “ สูงสุด_ความยาว ” อาร์กิวเมนต์ที่ตั้งค่าเป็น “ ยี่สิบ ” ซึ่งบ่งชี้ว่าข้อความที่สร้างขึ้นจะถูกจำกัดอยู่เพียงโทเค็นที่ให้มา “ num_return_sequences ” ที่ตั้งค่าเป็น “ 5 ” ซึ่งแสดงว่าข้อความที่สร้างขึ้นจะขึ้นอยู่กับลำดับข้อความ 5 ลำดับ:

เอาท์พุท = แบบอย่าง ( **เข้ารหัส_อินพุต )เครื่องกำเนิดไฟฟ้า ( gen_text , สูงสุด_ความยาว = ยี่สิบ , num_return_sequences = 5 )

เอาท์พุต

จะใช้โมเดลที่ใช้ Transformer เพื่อสร้างข้อความใน TensorFlow ได้อย่างไร

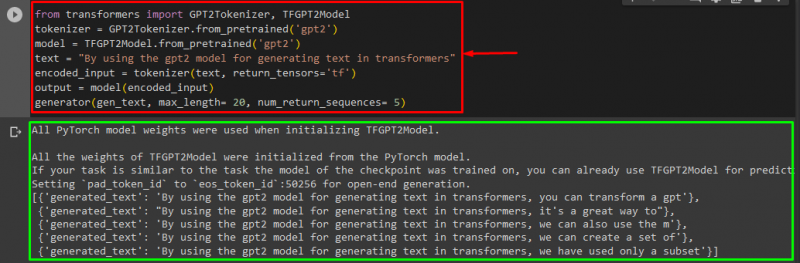

สำหรับการสร้างข้อความใน Transformers นั้น “ เทนเซอร์โฟลว์ ” นอกจากนี้ยังใช้เฟรมเวิร์กการเรียนรู้ของเครื่องที่ใช้พื้นฐาน ในการทำเช่นนั้น ขั้นแรก ให้นำเข้าฟังก์ชันที่จำเป็น เช่น “ GPT2Tokenizer ' และ ' TFGPT2รุ่น ' จาก ' หม้อแปลงไฟฟ้า '. โค้ดที่เหลือก็เหมือนกับข้างบน เพียงเราใช้เครื่องหมาย “ TFGPT2รุ่น ” ทำหน้าที่แทน “ GPT2โมเดล ' การทำงาน. ดังต่อไปนี้:

จาก หม้อแปลงไฟฟ้า นำเข้า GPT2Tokenizer , TFGPT2รุ่นโทเค็นไนเซอร์ = GPT2Tokenizer. from_pretrained ( 'gpt2' )

แบบอย่าง = TFGPT2รุ่น from_pretrained ( 'gpt2' )

ข้อความ = “โดยใช้โมเดล gpt2 เพื่อสร้างข้อความในหม้อแปลง”

encoded_input = โทเค็นไนเซอร์ ( ข้อความ , return_tensors = 'ทีเอฟ' )

เอาท์พุท = แบบอย่าง ( encoded_input )

เครื่องกำเนิดไฟฟ้า ( gen_text , สูงสุด_ความยาว = ยี่สิบ , num_return_sequences = 5 )

อย่างที่คุณเห็น ข้อความที่ปรับแต่งได้ถูกสร้างขึ้นสำเร็จแล้ว:

แค่นั้นแหละ! เราได้อธิบายรายละเอียดเกี่ยวกับการปรับแต่งการสร้างข้อความใน Transformers

บทสรุป

ในการปรับแต่งการสร้างข้อความใน Transformers มีหลายวิธี เช่น การโหลดโมเดลด้วยฟังก์ชันไปป์ไลน์ โดยใช้โมเดลที่ใช้ Transformer ใน “ ไพทอร์ช ' และ ' เทนเซอร์โฟลว์ ” ซึ่งอิงตามกรอบการเรียนรู้ของเครื่อง ในคู่มือนี้ เราได้ให้ข้อมูลโดยย่อพร้อมกับการสาธิตเชิงปฏิบัติของการปรับแต่งการสร้างข้อความใน Transformers